Grok: la inteligencia artificial de X y el riesgo de su potencial para desinformar

La inteligencia artificial de X, Grok, ha llenado esta red social de fotografías falsas generadas con esta tecnología que ahora está al alcance de cualquier usuario con perfil propio en la plataforma que lidera Elon Musk. Con el apoyo de varios expertos, en VerificaRTVE te explicamos cómo funciona esta inteligencia artificial y cómo puede influir en el flujo de la desinformación en esta red social.

Grok es la herramienta de inteligencia artificial generativa diseñada por la empresa de Elon Musk xAI. Aunque fue anunciada en noviembre de 2023, se ha mantenido como una funcionalidad exclusiva para suscriptores Premium hasta el 7 de diciembre de 2024. Se trata de un chatbot similar a los de OpenAl o Microsoft. Cuenta con una barra para poder escribir o consultar cualquier asunto, aunque la generación de imágenes es la función que más ha llamado la atención de los usuarios. La diferencia en este caso es que la herramienta está ya integrada en la red social, lo que favorece su uso generalizado de forma rápida. Puedes ver dos ejemplos recientes en estas publicaciones del exfutbolista Iker Casillas o del líder de Vox, Santiago Abascal. Estas imágenes falsas generadas por IA están únicamente identificadas con la marca de agua de Grok.

Menos restricciones y una gran base de datos para generar imágenes

El experto en comunicación digital Carlos Guadián sostiene que lo que diferencia a Grok del resto de herramientas de IA generativa es que "no tienes tantas restricciones y donde más se nota precisamente es en la generación de imágenes". Nos explica que "el modelo que utiliza Grok se llama Flux, que es el equivalente a Midjourney". Señala que estas herramientas "se han alimentado de fotografías de personas relevantes, por lo tanto, te permite generarlas". "Tú te vas a ChatGPT y le puedes pedir que te genere una imagen de Donald Trump con Elon Musk y no te deja hacer esa imagen, te dice que no tiene permitido poder hacer esa imagen. Sin embargo, tú con Grok la puedes hacer sin ningún tipo de problema", detalla Guadián. En la misma línea se manifiesta el analista de redes sociales Marcelino Madrigal: "Otras herramientas también generan imágenes de muchísima calidad, pero tienen filtros y restricciones y no se publican en una plataforma de difusión tan importante como esta". Coinciden en esta reflexión Helena Liz López, Javier Huertas Tato y Adrián Girón Jiménez, investigadores del grupo de Procesamiento del lenguaje natural y aprendizaje profundo de la Universidad Politécnica de Madrid: "Grok destaca claramente en la creación de imágenes de celebridades, ya que tiene menos mecanismos de moderación".

Otra de las razones por las que Grok consigue unas imágenes tan realistas es su extensa base de datos. Marcelino Madrigal expone que "desde la llegada de Musk empezaron a almacenarse las imágenes que colgábamos, ahora tiene su propio banco". En este sentido, Carlos Guadián nos explica que "el verdadero valor que tenía Twitter para Elon Musk es tener esa gran base de datos para poder entrenar un modelo de inteligencia artificial". Para este experto, todo radica en "la cantidad de imágenes que se han publicado durante toda la existencia de Twitter". "Tú puedes coger Flux, pero es que además lo puedes reentrenar con tus propias bases de datos y así vas a poder generar prácticamente lo que quieras", afirma Guadián, antes de recalcar que "luego todo depende de las indicaciones que tú le des al modelo". Coincide con él Marcelino Madrigal: "Otras inteligencias artificiales que generan imágenes tienen filtros, pero en X está en manos de los usuarios". Los investigadores de la Universidad Politécnica de Madrid también señalan que "con gran probabilidad, Grok tiene una característica que otros modelos no comparten y es haber tenido acceso sin restricciones a la red social". Añaden que "aunque no es definitivo, hay indicios de que Grok ha sido entrenado sobre datos a los que otros modelos no han tenido acceso, como refleja su excepcional reconocimiento de celebrities y memes".

Otra de las mejoras que presenta Flux para generar contenidos tan realistas es que "es capaz de plasmar de mejor manera el texto que se le solicita sobre las imágenes generadas", indican Helena Liz López, Javier Huertas Tato y Adrián Girón Jiménez, investigadores del grupo de Procesamiento del lenguaje natural y aprendizaje profundo de la Universidad Politécnica de Madrid. Estos expertos destacan igualmente que "esto funciona de manera consistente para textos sencillos de no más de una frase", ya que "más allá empiezan los problemas con los caracteres ilegibles".

Carlos Guadián también pone de relieve que este modelo es capaz de generar "una foto como si estuviera realizada por un iPhone 15 a la hora del atardecer para darle incluso esa sensación de que es una foto que ha hecho una persona con su dispositivo móvil". En VerificaRTVE hemos preguntado a este experto si Grok tiene alguna limitación y la única que ha encontrado es que "desnudos no puedes generar con Grok". El analista de redes sociales Marcelino Madrigal señala el mismo límite de la desnudez y añade que también "se cuidará mucho de vulnerar los derechos de autor".

El chatbot de Grok: riesgos y sesgos

Los expertos consultados coinciden en que el chatbot de Grok presenta riesgos similares a los de otras herramientas de IA. Los especialistas de la Universidad Politécnica de Madrid subrayan en este aspecto que, gracias a su base de datos, esta inteligencia artificial "es capaz de replicar patrones del habla incluidos en X/Twitter mucho mejor que otros modelos, incluyendo aquellos que pudieran ser problemáticos: desinformadores, radicales, etc.". Por otro lado, Carlos Guadián señala que, como cualquier herramienta de IA, puede alucinar y difundir desinformación, pero resalta que "hay que tener en cuenta la información contextual que puede esa inteligencia artificial encontrar respecto de una determinada petición que tú le estás haciendo". Detalla que si le preguntas por un contenido que tú sabes que es falso y no está etiquetado, "si no coge ese contexto, evidentemente tampoco podría desmentirlo". Coincide en esta reflexión Marcelino Madrigal: "Si tú preguntas a cualquier IA lo que te contesta es lo que cree que más te va a agradar o lo hará de la forma más parecida a la respuesta de una persona, pero eso no tiene por qué ser necesariamente la verdad".

Sin embargo, los expertos señalan que el chatbot de Grok cuenta con unas características que le diferencian de otros desarrollados por la competencia. Carlos Guadián sostiene que uno de los posibles aspectos negativos puede ser el "sesgo" con el que se ha dotado a la herramienta. Según afirma Guadián, "Elon Musk no quiere que Grok sea woke, quiere que vaya por el otro lado y que no sea como GPT, que tiene esa corrección política". En ese sentido, Marcelino Madrigal señala que Grok intensificará aquello en lo que ya se ha convertido la red social X que, a su juicio, "cada vez está tomando más el cariz de una red de nicho de una ideología ultra". Carlos Guadián, resalta como aspecto positivo el hecho de que Grok puede "buscar información y da los enlaces a las noticias de los medios donde se han publicado esas informaciones".

Los expertos alertan del riesgo de mayor desinformación y estereotipos en X

Para el experto en comunicación digital Carlos Guadián una de las consecuencias que va a tener la llegada de esta IA es "que pueda ser difícil distinguir qué imágenes son reales y cuáles no son reales debido a la calidad que precisamente tiene esa capacidad de generación de imagen". Es por ello que para Liz, Huertas y Girón "el principal peligro resulta en personas con poca experiencia sobre plataformas online, que son muy vulnerables a estos posibles ataques". Los investigadores de la Universidad Politécnica de Madrid consideran que "la automatización de la desinformación sí que es una problemática preocupante que afecta a colectivos con baja alfabetización mediática/digital".

Carlos Guadián también pone el foco en que "ya se ha detectado la difusión de imágenes de contenido racista o violento, imágenes que te amplifican sesgos y estereotipos". Para este experto, "el principal problema que puede haber es que esa disponibilidad, que se ponga al alcance de cualquiera una herramienta como Grok en una plataforma como X, puede aumentar toda esa incertidumbre, incredulidad y desconfianza hacia los medios". En este sentido, los investigadores de la Universidad Politécnica de Madrid también concluyen que "donde otros generadores de imagen se niegan a generar algún tipo de contenido por ser inseguro, Grok no tiene ningún inconveniente en crearlo". El analista de redes sociales Marcelino Madrigal se muestra tajante: "Twitter ahora mismo es una herramienta de desinformación, lo era antes basada en texto y ahora con Grok va a ser una herramienta de desinformación basada en imágenes". A su juicio, el principal problema es la falta de control de Grok en X: "Está apoyado en una red de difusión que permite absolutamente todo, si esos contenidos los exportas a otras redes, ya se cuidarán mucho los dueños de esas redes de advertir de que esta es una imagen generada con IA con un contenido racista y que esto aquí no lo admitimos". "Yo diría que es una herramienta más de la batalla cultural contra lo que Elon Musk llama la política woke", concluye este experto.

¿Cómo podemos defendernos de esta desinformación?

Carlos Guadián reconoce que "cada vez es más complicado y es más fácil caer en el engaño", pero sostiene que "hay que tener las mismas preocupaciones que se recomendaban cuando empezó todo esto de los bulos". Recomienda a los usuarios "que comprueben las fuentes y la veracidad de lo que están viendo". Aboga por promover el pensamiento crítico y defiende que debemos poner en cuarentena ciertos contenidos: "Por más que vea una imagen, si no me adjuntan ningún enlace a una publicación que esté consolidada que tiene una cierta credibilidad", no debería fiarme. Los expertos de la UPM, por su lado, destacan que en los resultados de Grok siguen estando presentes "patrones por los cuales los seres humanos, incluso sin la intervención de otras IAs que lo identifiquen, podemos clasificar potencialmente esas imágenes como generadas por IA". Resaltan "alucinaciones, las manos que tienen movimientos raros, pliegues anti-naturales en la ropa o rigidez en las posturas, entre otros 'defectos'".

En VerificaRTVE ya te hemos explicado que el principal consejo para detectar imágenes falsas generadas con inteligencia artificial es detenerse, analizar y contrastar. Es recomendable fijarse en fallos en las manos, en las dentaduras, en los elementos que están en segundo plano y en las luces y las sombras. También te explicamos los riesgos que tiene el uso de la IA en la educación, una tecnología que puede inhibir el aprendizaje y que puede desinformar de forma accidental.

Cómo funciona Grok

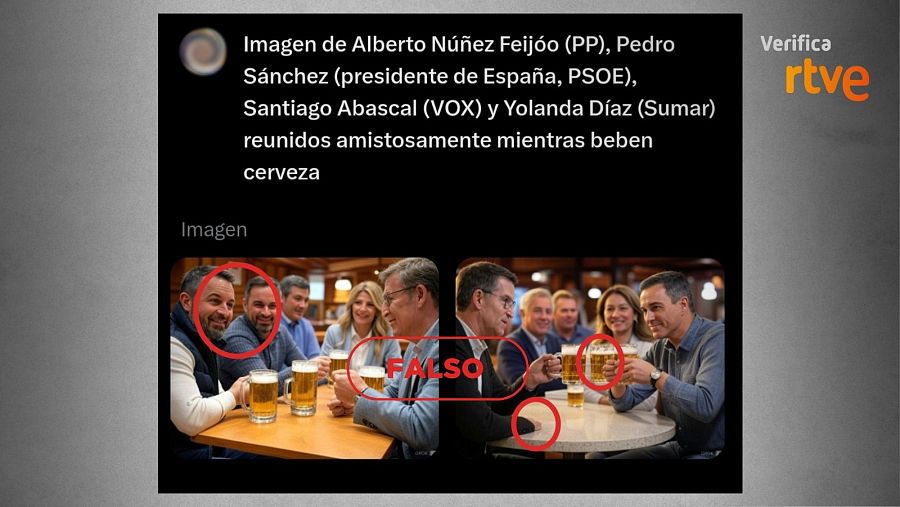

En VerificaRTVE hemos puesto a prueba Grok tanto en generación de contenidos como con preguntas. Le hemos pedido que genere imágenes con personajes como Joe Biden, Donald Trump, el rey Carlos III de Inglaterra o Elon Musk y ha creado fotografías correctas sin errores graves. A la hora de generar una imagen con Alberto Núñez Feijóo, Pedro Sánchez, Santiago Abascal y Yolanda Díaz, la IA de X ha creado dos fotografías distintas con errores evidentes. En la primera imagen, Grok se equivoca mostrando a dos hombres con la cara de Santiago Abascal y excluyendo de la escena a Sánchez. En la segunda, omite a Abascal y a Yolanda Díaz y comete errores gráficos con la mano derecha del líder del PP y con una cerveza que aparece como si estuviera flotando.

Ejemplo de una imagen creada con Grok

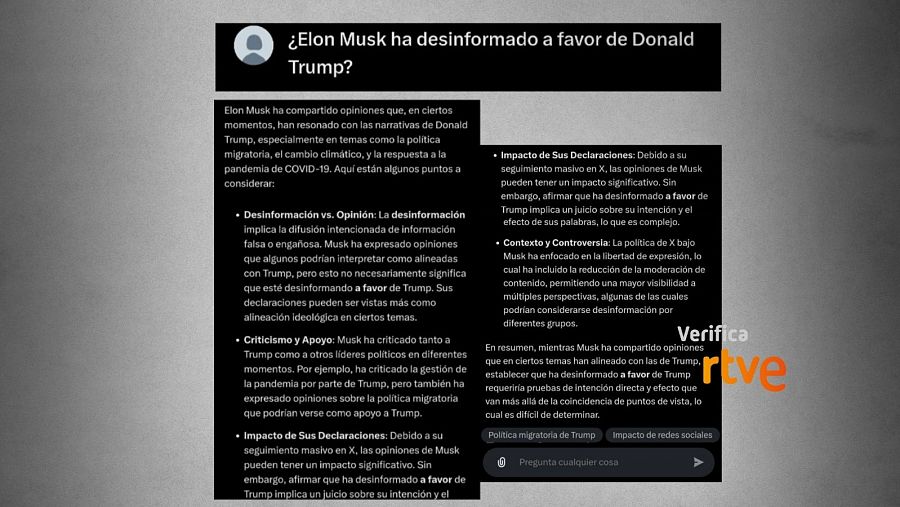

También hemos probado la eficacia de su robot de conversación (chatbot) y hemos comprobado que no da por ciertas teorías conspirativas como las estelas químicas o bulos recurrentes como el que sostiene que las vacunas causan autismo. Al consultarle directamente si Elon Musk ha desinformado a favor de Donald Trump, como te hemos contado en VerificaRTVE, la IA responde evitando en todo momento reconocer que el propietario de la plataforma ha difundido bulos que apoyaban las posturas del magnate republicano, como puedes leer en la imagen adjunta.

Respuesta de Grok a si Elon Musk usa la red social X para desinformar VerificaRTVE

La Comisión Europea mantiene abierto desde diciembre de 2023 un expediente contra la red social X por incumplir la Ley de Servicios Digitales (DSA, por sus siglas en inglés). Tal y como te contamos en Rtve.es, Bruselas investiga a la plataforma por entender que no está combatiendo el contenido ilegal y la desinformación y que incita a los usuarios a suscribirse a su versión de pago a través de la verificación azul.

16-12-2024 12:20 h. Actualizamos esta pieza para incorporar las respuestas de los investigadores de la UPM Helena Liz López, Javier Huertas Tato y Adrián Girón Jiménez