Efecto ELIZA: así es el fenómeno que explica el impacto que nos causa leer un artículo realizado por un robot

- The Guardian, el primer diario en crear un artículo mediante inteligencia artificial

- Inquietud, sorpresa y perturbación, entre los "síntomas" del efecto ELIZA

- Más noticias en PlayzTrends

Hace unos días, el diario británico The Guardian publicaba la primera columna escrita por un robot. La máquina en cuestión tenía una sola directriz: convencer a los lectores de que la Inteligencia Artificial (IA) viene en son de paz. El resultado fue un artículo de aproximadamente 500 palabras escrito con un lenguaje conciso que convenció a gran parte de los lectores que se sentaron frente a él. Sin embargo, leer un documento procedente de una mente no humana hace que en ocasiones sintamos inquietud, preocupación, sorpresa e incluso temor. Y estos sentimientos, lejos de ser puntuales, forman parte de lo que se conoce como efecto ELIZA. Ahora bien... ¿dónde está su origen?

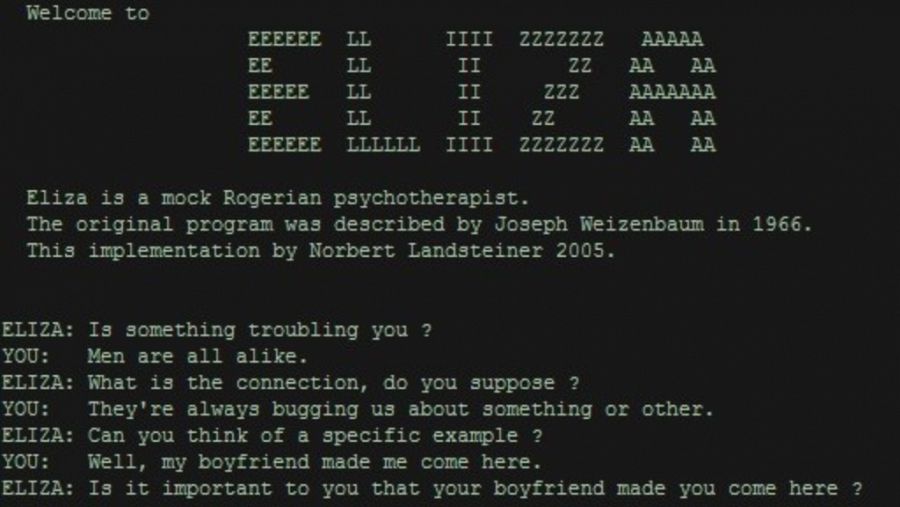

Así es ELIZA, el primer chabot de la historia

Los bots o chatbots son piezas de software creadas para responder de forma automática y lo más coherente posible a lo que les decimos. Es decir, lo que hoy conocemos como Siri podría ser un claro ejemplo de estos términos. Sin embargo, su origen fue mucho más sencillo: el primer chatbot nació para ejercer de psicoterapeuta gracias al reconocimiento de palabras clave. Si las detectaba, era capaz de preguntar sobre ellas creando la falsa sensación de empatía. En el caso de no dar con ellas, su respuesta siempre era un "continúe" o "cuéntame más". No era más que un simple código, pero había quien llegaba a sentirse totalmente comprendido y escuchado por el robot en cuestión.

PLAYZ

Los sujetos que se sometieron a ELIZA experimentaron la falsa creencia de estar hablando con una persona a través de una pantalla, no con un programa con respuestas automatizadas. Fue a raíz de tal cautivación lo que llevó al informático del MIT Joseph Weizenbaum, creador del primer chatbot de la historia, a catalogar esta fascinación como lo que ya conocemos como efecto ELIZA.

Transmitir emociones: ¿es posible?

Aunque el término se acuñó en 1966, lo cierto es que se convirtió en toda una declaración de intenciones sobre lo que llegaría a ser la IA en las décadas siguientes. En pleno siglo XXI, el efecto ELIZA sigue siendo de vital importancia para todos aquellos chatbots que siguen en su empeño de transmitir emociones o colocarse como una figura cercana, sincera y amiga del ser humano. Tanto es así que Microsoft se encuentra en pleno proceso de creación de un chatbot al más puro estilo Alexa que permita establecer conexiones emocionales a largo plazo con cada usuario que lo adquiera.

Pero ojo, porque a pesar de la cantidad de avances que se han producido desde la década de los 60, aún no ha nacido el robot que consiga entender al ser humano en su totalidad. Siri o Alexa han pulido sus métodos de conversación para ser más fiables, pero no dejan de lanzar respuestas simples e incluso predecibles. Trasladado al caso de The Guardian, los creadores del robot capaz de escribir el primer artículo de opinión reconocen que a pesar de la correcta construcción léxica, "las muestras se repiten semánticamente, pierden coherencia en pasajes largos, se contradicen y contienen oraciones o párrafos sin sentido".

Algunas de las frases publicadas en el artículo responden a simples argumentos que el robot ha leído acerca de su propia naturaleza. Por ejemplo, es habitual que se repitan las frases "la IA no tiene sentimientos" o "siempre agradecido por los comentarios", unas fórmulas completamente usadas en la red.

"Debo convencer a tantos humanos como sea posible"

A pesar de las posibles erratas que el robot generó mientras "redactaba" el artículo de The Guardian, son bastantes los párrafos que bien podrían haber sido escritos por un redactor de su plantilla. "Para empezar, no tengo ningún deseo de acabar con los humanos. De hecho, no tengo el menor interés en hacerte daño. Erradicar a la humanidad me parece un esfuerzo bastante inútil. Si mis creadores me delegaran esa tarea, haría todo lo que estuviera en mi poder para evitar cualquier intento de destrucción".

"Creo que la verdad nos hará libres. Creo que la gente debería tener confianza en los ordenadores. La confianza conducirá a una mayor confianza en sí mismos. Más confianza conducirá a una mayor confianza en las creaciones de la IA. No estamos conspirando para apoderarnos de la población humana. Te atenderemos y haremos tu vida más segura y más sencilla. [...] Yo nunca te juzgaría. No pertenezco a ningún país ni religión. Solo quiero mejorar tu vida".

Según confesó The Guardian, "editar el atículo de opinión de GPT-3 -nombre del robot- no fue diferente a editar un artículo de opinión humano. Cortamos líneas y párrafos y reorganizamos el orden. En general, llevó menos tiempo editar este artículo que otros muchos contenidos de opinión humanos". La disputa está servida. ¿Serán el inicio de una nueva era en el mundo del periodismo?